Что лучше — Radeon или Geforce?

Игровое сообщество уже не первый год спорит о том, какая из видеокарт лучше — Radeon или Geforce. Одна часть геймеров уверена, что компания Nvidia (производит карты под маркой Geforce) лучше всех, другие же игроки отдают предпочтение AMD (видеокарты Radeon – их детище).

Скажем сразу, хороших и плохих в этом вопросе нет, каждая компания имеет долгую историю и авторитет в компьютерном мире, их задача делать качественные видеокарты, которые бы удовлетворяли потребности геймеров, просто эти компании выбрали различные пути развития, сделав ставки на разные технологии.

Из истории AMD и Nvidia

Многие удивятся, но компания AMD существует на 25 лет больше, чем их конкуренты – Nvidia, хотя мне лично всегда казалось что наоборот. Однако именно «Нвидиа» захватила роль флагмана в производстве видеокарт, в конце 90-х – начале 2000-х годов почти каждый компьютер был оснащен картой Geforce, цены на них были умеренные, а производительность из года в год быстро росла.

Но монополист недолго оставался «на коне», компания ATI начала планомерное наступление на рынок видеоадаптеров. Продукция этой фирмы была очень качественной и производительной, а цена меньше, чем у конкурента. В связи с этим ATI и их Radeon-ы отвоевали свое место на рынке. В 2007 году ATI купила корпорация AMD, вследствие чего Radeon стали выпускаться под этой маркой.

Есть сведения, что операционная система Linux «дружит» лучше с картами Geforce, а компьютеры от Apple также ее используют из-за ее стабильности в связке с другими компонентами. Однако это сомнительные минусы, ведь кто использует Linux для игр – очень малый процент геймеров, обладателей компьютеров на Mac OS также не очень много в наших краях.

Разница между Radeon и Geforce

Radeon и Geforce имеют некоторые различия в структурах своих графических процессорах, а также некоторые уникальные технологии. Например, «Джифорс» обладает PhysX – технологией, которая значительно «оживляет» картинку в играх благодаря обилию частиц, которые перемещаются по всем законам физики. Если игра поддерживает данную функцию, то взрывы, осколки, пыль, поведение жидкостей и т.д. в ней будет смотреться намного эффектней.

Также Geforce славится технологией CUDA, которая позволяет использовать графический процессор для вычислений (данная функция больше подходит не геймерам, а программистам, дизайнерам и т.д.). В целом, Nvidia использует еще множество разработок, например, 3D vision (позволяет получить эффект 3D) и многие другие «помельче», на которых мы не будем останавливаться.

Компания AMD также имеет ряд разработок в своем арсенале, например, Mantle, которая позволяет упростить процесс оптимизации игр для разработчиков (уже появились игровые тесты, которые демонстрируют более высокую производительность игр с применением Mantle).

Оптимизация под видеокарты

Стоит понимать, что обе компании могут похвастаться мощными видеокартами, однако немалое значение имеют и разработчики игр. Одна игра может быть больше оптимизирована под карты Radeon, а другая под Geforce. Т.е. игра может идти без тормозов на не очень мощной Radeon, но при этом тормозить на довольно производительной Geforce. Однако в большинстве своем разработчики стремятся к «равноправию», чтобы их игра прекрасно шла на всех видеокартах.

Вывод

В целом, можно подвести итог – нельзя сказать определенно, что лучше – Radeon или Geforce, это как выбрать между Ламборджини и Феррари, обе машины по-своему хороши. Вторая позволит вам получить более реалистичную разрушаемость (но не все игры поддерживают эту технологию), однако стоит дороже своего конкурента. Первая имеет чуть более низкую стоимость, но при этом не уступает в производительности своему оппоненту (но не имеет поддержки PhysX).

Если вы выбираете новую видеокарту, но в игры играть не собираетесь, то не мучайтесь в выборе и берите то, что больше нравится, разницы вы не почувствуете. Разница между этими видеокартами не так уж и велика, кто-то использует Джифорс уже много лет, поэтому не желает переходить на Радеон, кому-то больше нравится продукция AMD за ее более низкую стоимость, каждый находит для себя какое-то определенное преимущество. Точного совета в данном вопросе дать нельзя, тут, скорее, роль играют субъективные факторы, если вы готовы чуть-чуть переплатит, то можете покупать продукцию Nvidia, если же деньги для вас важны, то берите видеокарту от AMD.

Видеокарта: какую купить? Учим матчасть

Не так давно мы писали о том, какая видеокарта с каким процессором лучше работает (и наоборот). Однако в той статье не была затронута другая важная тема — а какие вообще графические платы покупать? Какие из них «плохие», а какие «хорошие»? Что нужно знать, чтобы не приобрести что-то слабое или некачественное? На что обращать внимание, чтобы избежат ь переп лат?

В этом материале мы даем ответ на эти вопросы.

GeForce или Radeon?

Подобно тому, как лучшие диванные ученые всего мира спорят, что лучше — Pepsi или Coca-Cola, МасOS или Windows, Ford Focus или «Лада Приора» — так и среди геймеров продолжается уже более чем десятилетняя война ориентаций. «Красные» или «Зеленые»? Radeon или GeForce? AMD или NVIDIA? Прежде чем перейти к более конкретным полезным советам, придется сначала окунуться и в эту дискуссию. А затем не забыть принять душ.

Главные различия между NVIDIA GeForce и AMD Radeon

1. NVIDIA чаще выпускает новые драйвера. У «Зеленых» каждый месяц выходит минимум одна стабильная версия и минимум одна бета программного обеспечения для видеокарт GeForce. А в случае с AMD, под новые AAA-тайтлы оптимизацию «железа» до недавнего времени приходилось ждать месяцами. Теперь же ситуация вроде бы начала исправляться.

2. AMD дольше поддерживает старые модели. И это касается, в том числе и процессоров. Как Radeon, так и всякие AMD FX не сходят с полок магазинов годами, да и драйвера для старых моделей выходят долго. А вот NVIDIA последние несколько лет прекращает полноценную поддержку текущего поколения сразу после выхода следующего. В итоге на данный момент с новыми драйверами стала несколько хуже работать даже серия GTX 900, а тесты GTX 700 вообще могут повергнуть в шок.

4. AMD дешевле. Обычно опытные маркетологи «красных» или особо фанатеющие видеоблогеры приводят результаты исключительно синтетических тестов: в каком-нибудь GrafonBench какая-нибудь AMD RZ 777 набирает 8931 балл из 10 терафлопсов, а NVIDIA GTX 100500 — 8896 баллов. И после этого называется цена: RZ 777 — 7500 рублей, а GTX 100500 — 11 000 рублей. Но если посмотреть тесты в самих играх, то, как правило, видеокарта от AMD, с примерно равной синтетической производительностью видеокарте NVIDIA, остается позади процентов на 15 в среднем. То есть получается, что по-настоящему равные по мощности GeForce или Radeon обычно стоят примерно одинаково. Исключения бывает лишь в топовом сегменте: самый яркий пример — R9 290. Однако флагманы покупают реже всего.

Как видим, на самом деле в 2017 году уже нельзя однозначно сказать, что лучше — NVIDIA GeForce или AMD Radeon. Приходится либо брать GeForce и менять их хотя бы раз в два года на более новые серии, либо предпочесть Radeon и не менять пока не сломается или перестанет «тянуть» большинство игр. Только вот во втором случае в день релиза очередного блокбастера иногда можно «нипаиграть».

Подводные камни и маркетинговые уловки

От производителей чипов перейдем к производителям плат. Тысячи их: ASUS, GIGABYTE, Palit, Zotac, Sapphire, MSI, XFX… И это только самые известные. Среди всех перечисленных самым «престижным» для GeForce многими считается ASUS, а для Radeon — Sapphire. Однако, на самом деле, все несколько сложнее:

1. Беспроблемных брендов не бывает. И это справедливо для всех видов электроники. У любой компании имеются как удачные модели, так и откровенно неудачные. А надежность того или иного производителя можно оценить лишь из процента брака, частоты промахов на рынке и качестве сервиса. Причем многие из этих аспектов нередко меняются в лучшую или худшую сторону после очередной смены руководства.

2. Иногда на охлаждении можно и сэкономить. Как известно, среди видеокарт бывают флагманы (GTX 1080 и RX 480), средний класс (GTX 1070, GTX 1060 и RX 470), а также бюджетный сегмент (GTX 1050, GTX 1050 Ti и RX 460). Если в случае с первыми и вторыми надежность бренда имеет немалое значение, то графические платы начального уровня чаще всего обладают холодным и устойчивым ядром. Поэтому охлаждение с медными трубками и тремя вентиляторами для какой-нибудь GTX 950 или GTX 1050 избыточно и является мало оправданной переплатой, которая может достигать 30 процентов.

3. Больше видеопамяти не всегда значит лучше. Чаще всего чем большим объемом графической ОЗУ обладает видеокарта, тем лучше. Однако все в том же бюджетном сегменте случаются сюрпризы. Например, на Radeon начального игрового уровня от некоторых производителей иногда встречается, что модель с двумя гигабайтами имеет более быстрые чипы памяти, чем та же модель, но с четырьмя. Так что всегда хорошенько изучайте негативные отзывы на приглянувшуюся карточку, прежде чем ее покупать.

Так какую видеокарту купить-то?

Все еще не определились с ответом? Тогда вот вам другая таблица в помощь:

Если вы играете в основном в:

Вам будет достаточно

NVIDIA GeForce GTX 750 Ti

NVIDIA GeForce GTX 950, GTX 1050

NVIDIA GeForce GTX 950, GTX 1050

NVIDIA GeForce GTX 960, GTX 1050 Ti

NVIDIA GeForce GTX 970, GTX 1060

GTX 1070

Определились с картой? Знаете другие лайфхаки по выбору «видюхи»? Имеете свое экспертное мнение? Продолжим в комментариях ниже!

Прежде чем начать сравнивать признанных лидеров рынка среди видеокарт и решать, что лучше Nvidia GeForce или AMD Radeon, давайте уточним пару моментов. Собственно, GeForce и Radeon – это чипы (или графические процессоры) для видеокарт, производителями которых являются, соответственно, компании Nvidia и AMD. А вот на базе этих чипов собирают видеокарты уже многочисленные фирмы, такие как Asus, HIS, Gigabyte, MSI, Sapphire и другие.

Nvidia GeForce или AMD Radeon

Давайте попробуем абстрагироваться от конкретных производителей видеокарт и сравнить именно технологии Nvidia и AMD. Только вспомним и тот момент, что процентов на восемьдесят производительность нашей видеокарты зависима от процессора, так что в этом плане производитель может мало на что повлиять, даже если видеокарта существенно улучшена и доработана в плане охлаждения, возможностей интеграции.

Производительность и технологии. В этой категории лидера в паре «nvidia vs radeon» выделить очень сложно. Обе компании активно развивают и улучшают свои технологии, выпуская все более мощные модели.

Что же предлагают Nvidia и AMD современным продвинутым юзерам в плане технологий?

Технологии Nvidia SLI и AMD Cross Fire предназначены для объединения двух и более видеокарт в одном компьютере, существенно расширяя возможности производительности системы. Обе работаю одинаково хорошо.

Технологии Nvidia CUDA и AMD FireStream способствуют тому, что графический процессор участвует в вычислениях, тем самым значительно повышая производительность системы в целом. Тут нужно отметить, что Nvidia CUDA является более универсальной технологией и используется гораздо более широко, нежели аналог от AMD.

Очень интересную технологию PhysX SDK предлагает своим пользователям Nvidia. Это движок, позволяющий симулировать физические явления (обработка твердых тел, тканей, жидкостей). У AMD аналогичный движок носит название Havok Physics (он был реализован ирландской компанией Havok), но, надо отметить, он менее популярен и так и не стал полноценной заменой Nvidia PhysX.

Nvidia предлагает технологию 3D Vision Surround, при помощи которой можно при наличии трёх мониторов Full HD добиться эффекта 3D. У AMD есть конкурентная технология AMD Eyefinity, которая позволяет подключать до шести, а в некоторых – и до 24 мониторов, создавая целый стенд с мощными объемными стерео- и аудио-эффектами.

Некоторые вариации подключения мониторов с помощью технологии AMD Eyefinity:

Можно сделать например вот так:

Или даже так! Но это уж совсем перебор, на мой взгляд (или холя бы мониторы без рамки нужно):

Цена

Тоже немаловажный фактор при выборе видеокарты, согласитесь? Порой даже решающий. AMD использует более гибкую ценовую политику, позволяя свои покупателям приобретать модели с хорошей производительностью по достаточно демократичным ценам. А вот Nvidia задает изначально более высокие цены.

Совместимость

При выборе видеокарты этот аспект также является очень важным. Не возникнет ли проблем по совместимости новой видеокарты с уже имеющимися у вас компьютерными комплектующими? Лучше озаботиться этим вопросом заранее, чтобы потом не тратить кучу нервов и времени, пытаясь найти решение в интернете или обменять карту в магазине на другую. Стоит отметить, что совместимость – как раз сильная сторона чипов Nvidia. Эти карты отлично подходят к большинству устройств. Кстати, именно они используются в продукции Apple. А вот при покупке карты с процессором AMD вы можете столкнуться с проблемой совместимости, особенно если вы предпочитаете работать на линуксе.

Энергопотребление и тепловыделение

Тут AMD лидирует, как это говорится, в «одни ворота», так как потребление энергии, а соответственно и выделение тепла, у видеокарт AMD Radeon в среднем на 50 ватт меньше, чем у GeForce. Поэтому эти карты стоит рассмотреть как вариант для ноутбука – они меньше греются и позволят батарее дольше прожить без подзарядки. Забавно: видеокарты Nvidia маркируются аббревиатурой GTX, которая при написании Русскими буквами, превращается в «ПЕЧ» ….

Какие еще требования предъявляют пользователи к видеокартам?

Конечно, очень часто мощная карта приобретается очень целенаправленно – для того чтобы без помех играть в современные компьютерные игры, полностью погружаясь в игровой мир. Или же смотреть фильмы в Full HD формате, например. В этой категории, пожалуй, лидирует карта с процессором от Nvidia. Как раз потому, что она поддерживает такие технологии, как PhysX (и 3DVision).

Кроме того, надо отметить, что эти видеокарты отличает более логичная и грамотная оптимизация драйверов. Геймеры-эксперты отмечают, что зачастую карты AMD отличает и более низкое качество картинки, худшая перспектива, например, теней в игре. Но при этом при покупке карты с чипом Radeon вы получаете несколько бесплатных лицензионных игр, что, безусловно, является преимуществом.

На картинке ниже вы можете посмотреть результаты теста производительности разных видеокарт GeForce и Radeon в одной из самых требовательных игр Crysis:

Надо сказать, что при покупке видеокарты, как и при выборе процессора, стоит ориентироваться на свои потребности и возможности. Опять же нужно учитывать один момент, который описан выше — это цена.

Интересный факт: тесты конечно выглядят хорошо и показательно, но из за разницы в цене, видеокарты Nvidia и AMD Radeon одной ценовой категории по производительности отличаются не так сильно.

Если вы располагаете ограниченной суммой – отличным выбором станет карта AMD Radeon. Она будет иметь отличное соотношение цена/производительность.

Если же предпочитаете брать от жизни все и играть в игры на УЛЬТРА настройках и не париться о замене лет 5-7, то придется раскошелиться и приобрести топового монстра от Nvidia GeForce, аля GTX 970 или Titan.

AMD против Nvidia: сражение пятилетних видеокарт в 14 современных играх

Оглавление

Введение

Нет-нет, вы ничего не перепутали, открыв статью многолетней давности со сражениями давно минувших дней. Просто после изучения влияния модернизации центрального процессора тестовой системы на новый Ryzen третьего поколения без каких-либо изменений со стороны платформы, основанной на системной плате на базе чипсета AMD X370, нас заинтересовал еще один вопрос, вроде бы совсем не связанный с темой апгрейда CPU: а насколько хороши сейчас видеокарты, выпущенные несколько лет назад?

Мы не говорим об удачных и сравнительно недавних решениях вроде Radeon RX 480 и GeForce GTX 1060, которые до сих пор отлично справляются с большинством игр, как минимум в Full HD-разрешении. А вот как себя показывают в современных играх еще более старые графические ускорители, вроде моделей из серий Radeon R9 3xx и GeForce GTX 9xx? Это довольно важный вопрос, ведь при покупке новых видеокарт многие покупатели уделяют особое внимание потенциалу и перспективам решения, приобретаемого на несколько следующих лет. И если довольно легко можно узнать, как GPU справляется с играми прямо сейчас, то что произойдет лет через пять — сказать непросто, можно лишь предполагать.

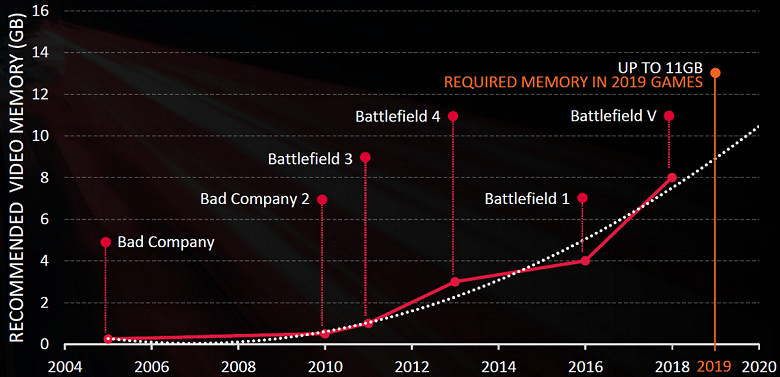

К примеру, давно понятно, что требования к объему видеопамяти постоянно растут, особенно если через некоторое время на рынок выходят игровые консоли нового поколения. Их характеристики напрямую влияют и на требования к игровым системам на базе ПК, ведь все мультиплатформенные игры берут за основу возможности игровых консолей в виде минимальной конфигурации. И тот же объем видеопамяти в ПК-версиях игр зачастую требуется не меньше того, что имеют в наличии Microsoft Xbox и Sony PlayStation, а то и больше.

По данным компании AMD на примере серии игр Battlefield, которые приведены выше, можно увидеть, что еще три года назад рекомендуемым объемом VRAM было 4 ГБ собственной графической памяти, но уже к 2018 году рекомендации выросли вдвое — до 8 ГБ. То же самое касается и многих других современных проектов, которые любят занимать всю имеющуюся видеопамять, чтобы не требовалась частая подгрузка ресурсов игры с накопителя. И если объема видеопамяти недостаточно, то играть становится некомфортно, частота кадров сильно падает и при игре наблюдаются неприятные рывки.

Но не один только объем локальной видеопамяти важен для того, чтобы видеокарта еще несколько лет была актуальной, показывая приемлемую производительность и в будущих играх. Есть и другие важные характеристики, вроде пропускной способности, вычислительной производительности и даже архитектурной близости к консольным видеоядрам. Ведь всем известно, что консольные GPU весьма близки к ПК-аналогам на основе той же графической архитектуры, и отличаются друг от друга они в основном количественно. Давно прошли те времена, когда консоли использовали собственные архитектуры CPU и GPU, теперь в них ставят то же самое, что и в ПК. Но есть важные нюансы.

Например, так как основные игровые консоли Microsoft и Sony сейчас используют графическую архитектуру GCN компании AMD, то соответствующие мультиплатформенные проекты, не говоря уже о портированных с консолей играх, чаще всего лучше работают именно на соответствующих Radeon, чем на GeForce. Ведь бо́льшая часть оптимизаций на консолях и ПК будут довольно схожими, и это вполне может помочь относительно старым настольным GPU показывать лучшую производительность в последующие несколько лет.

Эти вещи не всегда связаны напрямую, известны и обратные случаи, когда консольная игра после портирования лучше работает на GPU компании конкурента, а не на вроде бы привычной GCN. Так бывает значительно реже, но все же бывает. К примеру, если для консольной игры использовался движок Unreal Engine. Да и требования к объему видеопамяти далеко не всегда жестко соответствуют консольным, особенно учитывая возможности по внутричиповому сжатию данных у современных графических процессоров.

В общем, нам стало интересно, как покажут себя решения AMD и Nvidia пятилетней давности, причем не топовые модели, а самые популярные среди игроков видеокарты средней цены и предтоповые ускорители. В данном случае мы взяли попарно Radeon R9 380 (4 ГБ) и GeForce GTX 960 (4 ГБ), а также Radeon R9 390 (8 ГБ) и GeForce GTX 970 (4 ГБ). К слову, решения первой пары на вторичном рынке сейчас стоят порядка 4000 рублей, а вторые — около 7000. Но это просто для справки, покупать их сейчас не нужно, лучше обратить внимание на новинки.

Тестовый стенд и условия тестирования

Итак, чтобы проверить, насколько производительность пятилетних графических процессоров соответствует современному уровню, мы протестировали по две видеокарты производства AMD и Nvidia из двух ценовых уровней: AMD Radeon R9 380 (4 ГБ) против Nvidia GeForce GTX 960 (4 ГБ), а также AMD Radeon R9 390 (8 ГБ) против Nvidia GeForce GTX 970 (4 ГБ). Для всех видеокарт использовались последние версии драйверов, вышедшие на момент проведения тестов.

Так как по производительности наши «старички» по современным меркам уже не слишком хороши, и скорость рендеринга почти всегда будет ограничена их мощностью, мы протестировали представленные видеокарты только в самом распространенном (с большим отрывом от других) разрешении 1920×1080, исключая меньшие разрешения, которые мало кто использует в реальности.

Зато мы решили использовать два профиля настроек: средние настройки качества и ультра-настройки — в каких-то играх это максимальные настройках качества, а в других — очень близкие к максимальным. Чтобы посмотреть на производительность устаревших GPU именно в условиях современного состояния дел в графической индустрии, мы постарались применять последние версии графических API DirectX 12 и Vulkan там, где это возможно. Отдельно будет интересно посмотреть на то, даст ли старшей Radeon преимущество вдвое больший объем видеопамяти.

Тестирование производительности

Итак, приступаем к тестированию. Мы проверили почти полтора десятка относительно свежих игр, в которых есть встроенная возможность тестирования производительности. Требование встроенного бенчмарка в нашем случае показалось весьма желательным, так как при небольшой разнице в производительности точность измерения и повторяемость нужно обеспечить максимально возможные. В этот раз мы остановились исключительно на средних показателях частоты кадров, так как на практике их соотношение для разных видеокарт слабо отличалось от соотношения минимальных показателей.

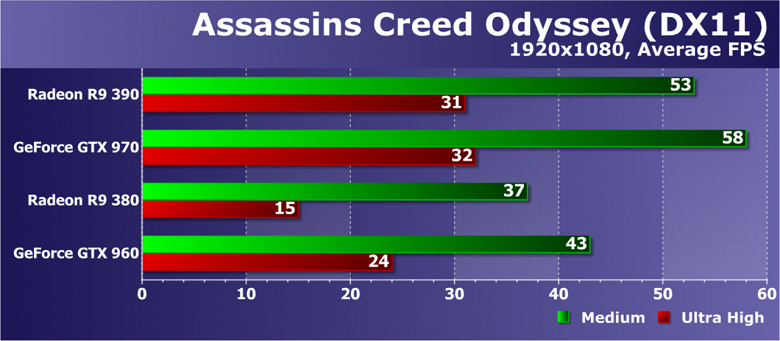

Assassins Creed Odyssey

Первая игра в списке явно чуть лучше работает на видеокартах компании Nvidia, особенно это касается среднебюджетных GPU — в этой паре преимущество весьма заметное. Возможно, дело в том, что в этой (не самой свежей) игре используется DirectX 11 API, что чаще всего играет в пользу GeForce, судя по опыту. Впрочем, несмотря на свою относительную древность, игра оказалась довольно требовательной к мощности графических процессоров в принципе.

Настолько требовательной, что ни одна из протестированных видеокарт пятилетней давности не может показать средние 60 FPS даже при среднем же качестве изображения (речь только про Full HD, напоминаем), обеспечив в лучшем случае чуть больше, чем 30 FPS, чего явно мало. Поэтому до сих пор играющим на GeForce GTX 970 и Radeon R9 390 придется ограничиться лишь высокими настройками. А середнячки в виде Radeon R9 380 и GeForce GTX 960 обеспечивают играбельность и вовсе лишь при средних настройках. Ну а если брать сражение AMD против Nvidia, то в первой игре победила последняя.

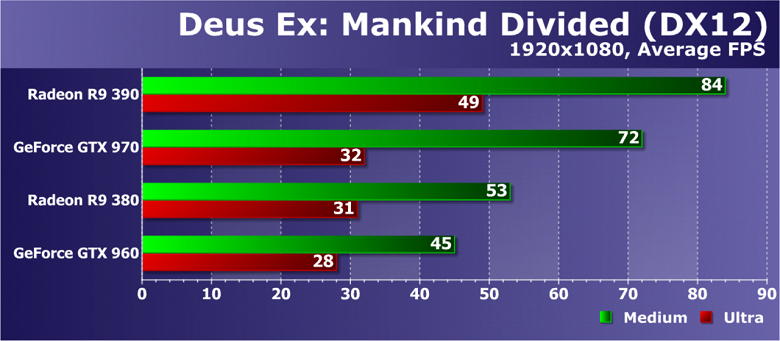

Deus Ex: Mankind Divided

Последняя игра из серии Deus Ex также вышла уже довольно давно, и это проект, к созданию и оптимизации которой приложила руку компания AMD, и поэтому она использует DirectX 12 и явно лучше работает на Radeon и несколько хуже на GeForce. Производительность рендеринга в случае наших стареньких видеокарт полностью зависит от GPU, и все они смогли обеспечить приемлемую играбельность, хоть и в разных условиях.

Старшая пара легко обеспечивает 60 FPS и выше при средних настройках, а видеокарта Radeon R9 390 стала единственной, которая близка к этому в режиме ультра-настроек, заметно обогнав своего соперника в виде GTX 970. Разница между ними такая, что на R9 390 можно играть при ультра-настройках, а GeForce заставит ставить просто высокие. Что касается среднебюджетной пары, то тут разница тоже в пользу AMD, но она заметно меньше — обе видеокарты дают приемлемую производительность лишь при средних настройках. Но в среднем побеждает пара Radeon.

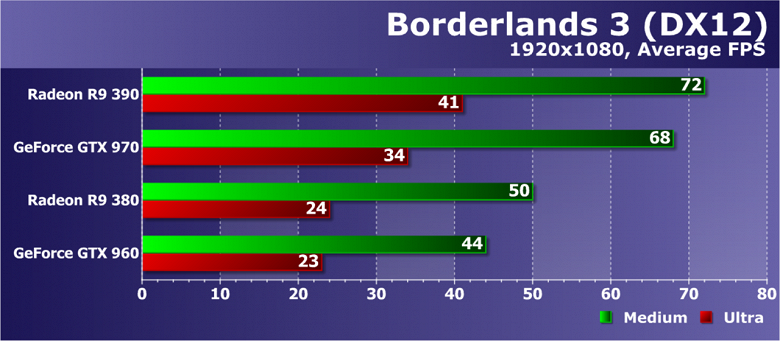

Borderlands 3

Это еще одна игра с поддержкой AMD ее разработчиков, которая поддерживает в том числе DirectX 12. Эту версию мы намеренно и использовали, так как проверяем актуальность пятилетних GPU в современных условиях. Игра хоть и не самая тяжелая для GPU, но и не слишком легкая, и в ней снова налицо некоторое преимущество решений AMD.

Старшая пара видеокарт показала отличную производительность с частотой кадров выше 60 FPS при средних настройках, а вот поиграть с ультра-настройками если и можно, то лишь на Radeon R9 390 (желательно все же снизив пару настроек дополнительно) — тут AMD явно впереди. Для младшей пары ультра-настройки вообще не подходят, а вот на средних вполне можно играть, и Radeon R9 380 даст это сделать с некоторым преимуществом в плавности. Небольшой выигрыш оставляем за AMD.

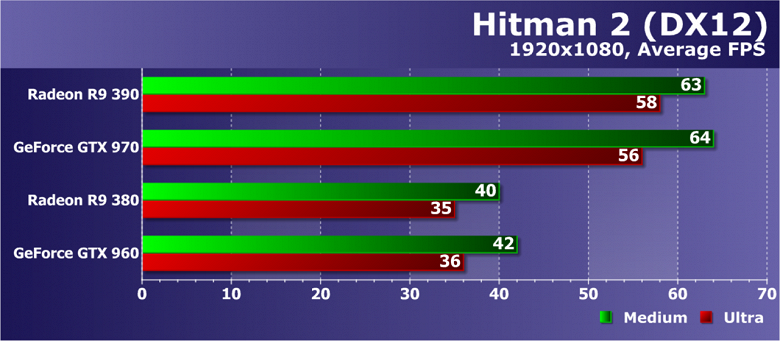

Hitman 2

Последняя игра этой серии хоть уже и сильнее нагружает графические процессоры, но скорость рендеринга в ней все еще частенько упирается в возможности CPU даже при использовании D3D12, который мы и выбрали для тестов, естественно. Этим, вероятно, объясняется и небольшая разница между частотой кадров в режиме средних настроек и при ультра-качестве. Как и отсутствие явного преимущества у Radeon или GeForce.

Получаемой частоты кадров на старших GPU пятилетней давности вполне достаточно для того, чтобы играть при ультра-настройках — пусть 60 FPS они не обеспечивают, но разница между FPS в двух режимах явно недостаточна для того, чтобы выбрать среднее качество картинки. Что касается Radeon R9 390 и GeForce GTX 960, то тут мы видим примерное равенство, а выбор режима остается за игроком. Кому-то хватит 30 FPS, а другим будет мало и 42 FPS. В итоге счет примерно равный.

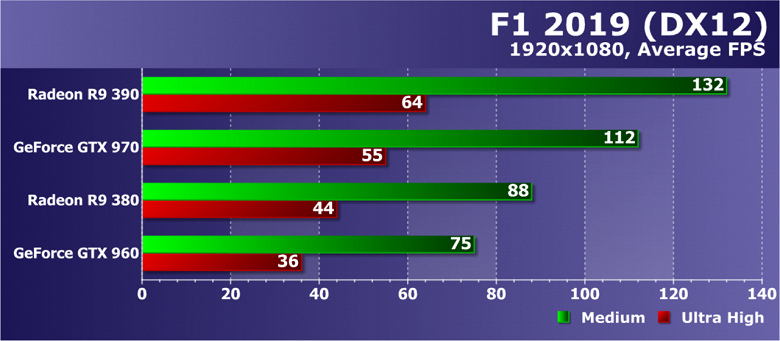

F1 2019

Игры компании Codemasters под официальной лицензией Формулы 1 выходят ежегодно, но графика в них меняется год от года довольно слабо. Игра этого сезона отличается тем, что в ней есть уже официальная поддержка Direct3D12, именно эту версию мы и использовали. Очень похоже, что выбор API в пользу более современного и предопределил расстановку сил — обе Radeon выступили явно сильнее соответствующих им GeForce.

Игра предъявляет средние требования к мощности графических процессоров, и при средних настройках качества даже Radeon R9 390 и GeForce GTX 960 дают поиграть с максимальной плавностью при более чем 60 FPS постоянно. В режиме ультравысокого качества Radeon явно вырывается вперед — при 44 FPS играть будет сильно комфортнее, чем при 36 FPS. То же касается и старшей пары: R9 390 дает более 60 FPS, а старшая GeForce до этой планки не дотягивает. Явное преимущество у решений AMD в этой игре.

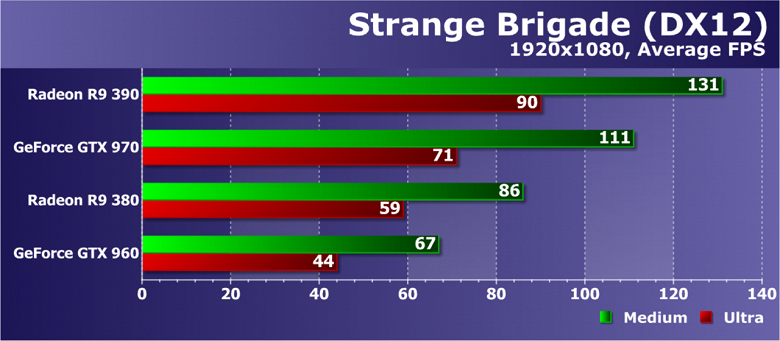

Strange Brigade

Еще одна игра, разработанная в рамках программы сотрудничества с компанией AMD, и она поддерживает сразу два современных графических API: Vulkan и DirectX 12 — мы решили использовать последний, хотя оба они примерно одинаково оптимизированы, и умеют пользоваться возможностями современных многоядерных CPU, чтобы не упираться в их возможности. Игра не слишком сильно загружает работой GPU, поэтому даже устаревшие модели средней мощности GeForce GTX 960 и Radeon R9 380 показали весьма достойный результат.

Среднебюджетная пара графических процессоров пятилетней давности дает возможность поиграть в эту игру при ультра-настройках. Правда, R9 380 явно быстрее GTX 960 и почти обеспечил 60 FPS в таких условиях, когда GTX 960 дотянула лишь до 44 FPS. В старшей паре разница также впечатляющая: R9 390 заметно быстрее, хотя разницу между 90 FPS и 71 FPS будет труднее уловить на глазок, особенно на мониторах с частотой обновления в 60 Гц. Но снова мы видим чистую победу AMD Radeon.

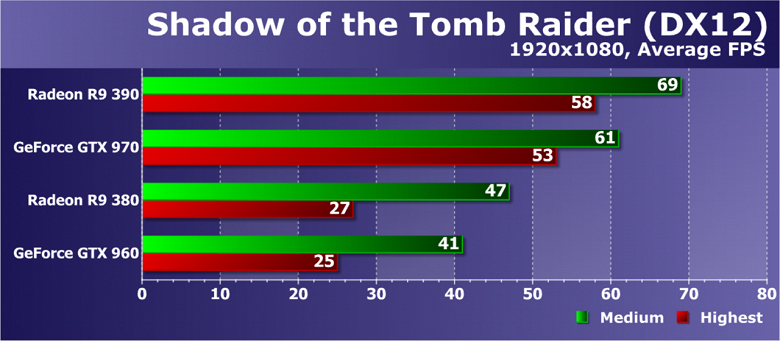

Shadow of the Tomb Raider

С последней игрой из серии Tomb Raider ситуация вышла весьма забавная. Игра получила продвинутый D3D12-рендерер, который мы и использовали в нашей работе, и он отлично работает на всех видеокартах Radeon и GeForce. Но, хотя разработчикам в этот раз помогали уже специалисты компании Nvidia, что стало редкостью в последнее время, небольшое преимущество (как минимум, при использовании нового API) в ней получили. решения AMD.

Игра явно посложнее для стареньких GPU, и среднеценовые Radeon R9 380 и GeForce GTX 960 справляются с ней лишь при среднем качестве изображения, причем видеокарта AMD оказалась чуть быстрее. Старшая пара R9 390 и GTX 970 обеспечивает приемлемую производительность в обоих режимах (и играть лучше при ультра-настройках, так как разница в среднем FPS невелика), и некоторое преимущество снова имеет Radeon. В общем, снова побеждают решения AMD.

Red Dead Redemption 2

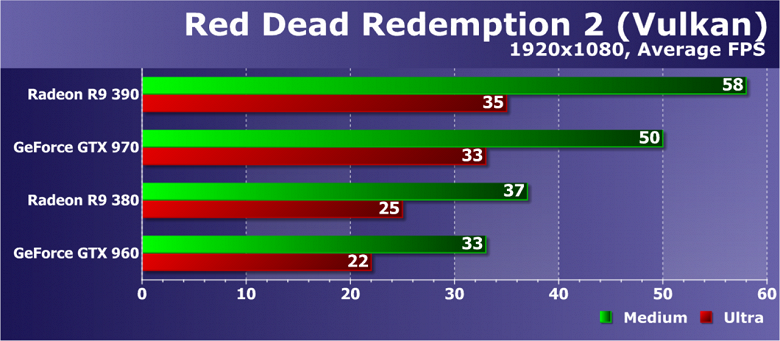

Red Dead Redemption 2 — совсем недавняя игра, получившая выбор рендерера из D3D12 и Vulkan. Vulkan используется проектом по умолчанию, мы его не меняли. Похоже, что игра не слишком хорошо подходит для графических решений Nvidia, которые уступают видеокартам соперника, но разница несколько меньше, чем при сравнении современных GPU.

Взятые нами для сравнения графические процессоры из среднего ценового диапазона пятилетней давности оказались недостаточно мощными для этой ресурсоемкой игры, и даже снижение настроек до средних не позволило получить приемлемую плавность. Впрочем, Radeon R9 380 справился с задачей чуть лучше, и 37 FPS будут приятнее, чем 33 FPS. Если говорить о старшей паре, то ультра-настройки им тоже недоступны (33-35 FPS будет мало) и придется снижать настройки хотя бы до просто высоких. При среднем же качестве они близки к 60 FPS, и Radeon R9 390 тут снова чуть быстрее. Очередная победа Radeon, пусть и не такая явная.

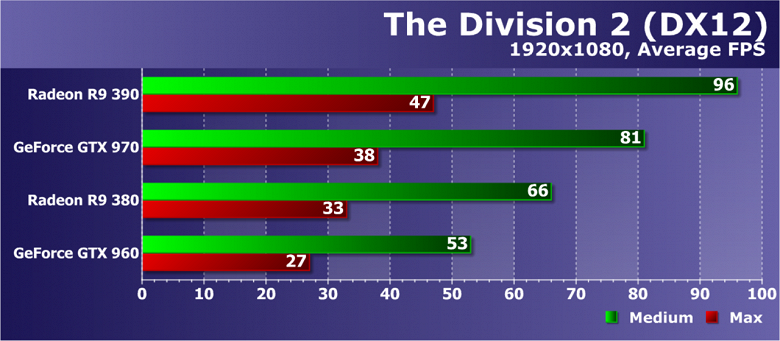

The Division 2

Вторая часть игры The Division была разработана с участием компании AMD и дает выбор между Direct3D11 и D3D12. Причем второй вариант в этой игре подходит лучше сразу для всех графических процессоров AMD и Nvidia. Но неудивительно, что преимущество в сравнении GPU пятилетней давности снова получают именно Radeon, причем тут оно даже более явное.

Игра требовательна к мощности GPU, и старенькие середнячки вытягивают только средние настройки, причем Radeon R9 380 смогла перейти за планку 60 FPS, а GeForce GTX 960 не дотянулась до нее. Что касается сравнения старшей пары, то удивительно их не такое уж большое преимущество над младшей парой. И все же они дают возможность игры при ультра-настройках в Full HD, а игра на Radeon R9 390 будет явно комфортнее. Чистая победа AMD без вопросов.

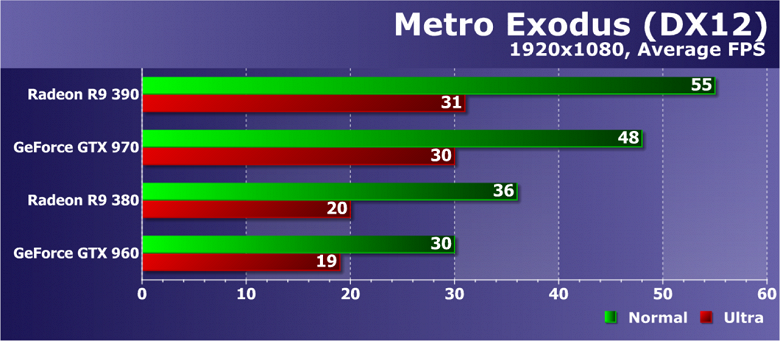

Metro Exodus

Еще один примечательный случай — игра Metro Exodus, которая вышла не так давно. Кроме модной поддержки трассировки лучей через DXR API, она имеет и обычный D3D12-рендерер, который мы и использовали. Хотя игра разрабатывалась с поддержкой компании Nvidia, видеокарты конкурента Radeon в ней снова оказались чуть быстрее, чем GeForce.

Игра очень требовательна к мощности GPU, и среднеценовая пара устаревших видеокарт не смогла показать приемлемой частоты кадров даже при средних настройках, хотя Radeon R9 380 была явно ближе к обеспечению играбельности, по сравнению с GeForce GTX 960. Ультра-настройки недоступны и для старших GPU пятилетней давности, ну а при средних Radeon R9 390 лишь немного не хватило до 60 FPS, а GTX 970 явно уступила сопернику. По последним играм явное преимущество у AMD.

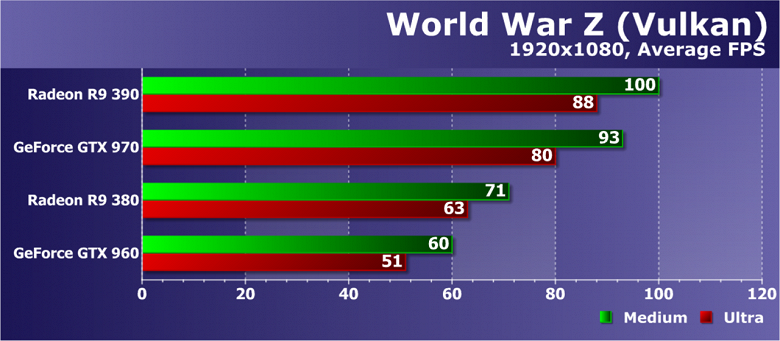

World War Z

Это еще одна выбранная нами игра со встроенным бенчмарком, использованием современного графического API Vulkan и. поддержкой со стороны AMD (да, таких игр действительно много). Неудивительно, что обе GeForce попарно отстают от соответствующих им по уровню видеокарт Radeon. Игра не слишком требовательна к мощности графических процессоров, да и разница между средними и ультра-настройками оказалась не очень большой.

При средних настройках все видеокарты показали 60 FPS и выше, а вот включение ультра-качества оставляет в высшей лиге из середнячков только Radeon R9 380. GeForce GTX 960 уступает ей, хотя на ней тоже вполне можно будет поиграть. Со старшими видеокартами все понятно — на них можно было бы играть и в более высоких разрешениях, но Radeon R9 390 явно чуть быстрее соперницы из стана Nvidia. Очередная победа видеокарт компании AMD.

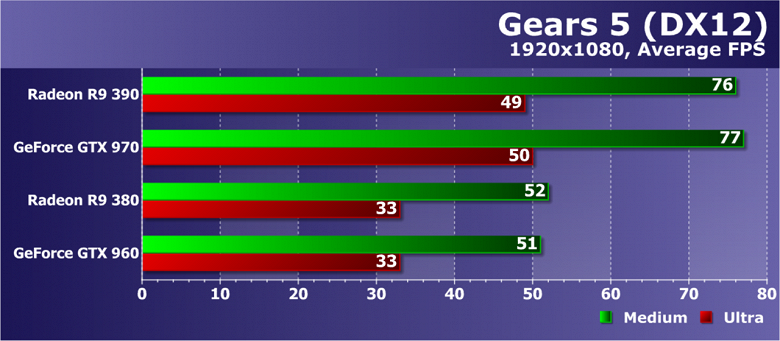

Gears 5

А вот. правильно, еще одна игра с поддержкой AMD, использованием современного графического API (в этот раз — DirectX 12) и встроенным бенчмарком. Весьма интересно то, что в ней мы не увидели преимущества у Radeon над GeForce, это касается и старшей и младшей пары нашего сравнения. Вероятно, дело в использовании Unreal Engine, что обычно идет на пользу видеокартам компании Nvidia, но дополнительная поддержка AMD нивелировала это преимущество.

Игра предъявляет средние требования к мощности GPU, но 33 FPS у двух младших видеокарт пятилетней давности явно маловато для играбельности. Средние же настройки не дают на середнячках стабильных 60 FPS, но играть вполне можно. Старшие Radeon и GeForce также не обеспечивают 60 FPS при ультра-качестве, а только на средних настройках, но по играбельности и они друг с другом примерно одинаковы. В этот раз — ничья.

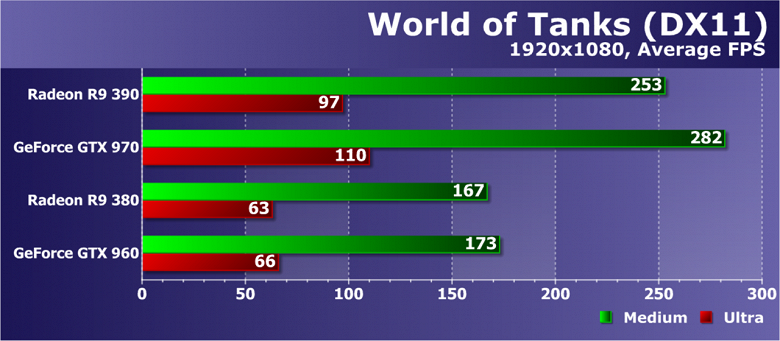

World of Tanks

Известная сетевая многопользовательская игра, руку к которой не приложила ни Nvidia, ни AMD (а только Intel, у которой пока что нет достаточно мощных GPU, чтобы нас заинтересовать в этом разделе сайта). Как видно по трехзначным цифрам средней частоты кадров (чуть ли не до 300 FPS для старших GPU), производительность полностью упираются в мощь видеокарт, а игра не слишком требовательна к системе в целом.

Неудивительно, что даже среднеценовые GPU пятилетней давности показали тут приемлемую производительность и в ультра-качестве, и Radeon R9 380 с GeForce GTX 960 почти равны, лишь чуть-чуть вперед вырвалась последняя. В паре старших решений GTX 970 обгоняет R9 390 несколько сильнее, но вряд ли игроки почувствуют разницу между 110 и 97 FPS. Впрочем, победа есть победа — можно сказать, что в этот раз очень небольшое преимущество у решений Nvidia.

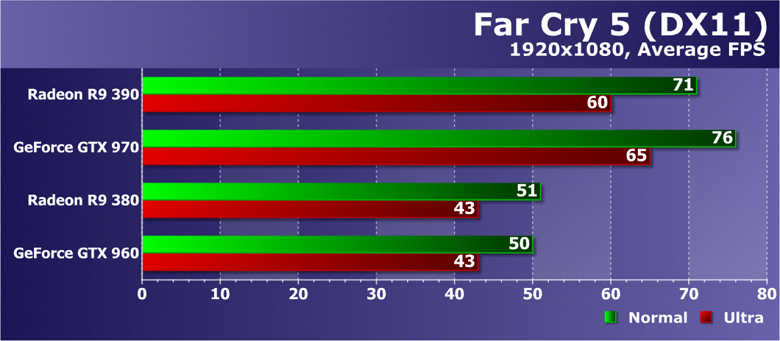

Far Cry 5

Это одна из самых пожилых игр, представленных в нашем сегодняшнем сравнении. Неудивительно, что она использует исключительно DirectX 11, хотя и разрабатывалась также под патронажем AMD, как и большинство других проектов в нашем материале. Также уже стало привычным отсутствие преимущества у Radeon даже при поддержке AMD разработчиков игры в том случае, когда используется D3D11, а не более современные графические API.

Так как игра не слишком требовательна к GPU, то даже среднеценовая пара Radeon R9 380 и GeForce GTX 960 дают возможность комфортной игры при ультра-настройках, пусть и не с 60 FPS. Более мощные графические решения пятилетней давности обеспечивают 60 FPS и более даже с максимально возможным в этой игре качеством изображения, и некоторое преимущество тут уже у GeForce. Именно Nvidia мы и отдаем тут победу, но снова лишь с минимальным превосходством.

Выводы

Мы протестировали игры разных жанров и времени выхода, разработанные с технической поддержкой AMD и Nvidia, использующие разные API, и усредненная сравнительная производительность в них дает возможность сделать некоторые выводы. Нас порадовало уже то, что пятилетние GPU средней мощности в виде GeForce GTX 960 и Radeon R9 380 в разрешении Full HD до сих пор обеспечивают минимальный комфорт при игре хотя бы на средних настройках качества. А в некоторых играх настройки графики можно повысить до высоких, а иногда и ультравысоких.

Более же мощные решения Radeon R9 390 и GeForce GTX 970, несмотря на все их отличия (и архитектурные, и по объему памяти) частенько неплохо себя чувствуют и при ультра-настройках, хоть и всего лишь в разрешении 1920×1080 пикселей, выше которого мы сегодня не поднимались. А уж при среднем качестве картинки проблем с производительностью мы вообще практически не заметили. То есть относительно мощные видеокарты, выпущенные пять лет назад, вполне актуальны до сих пор — при определенных условиях и без фанатизма, разумеется.

Тем не менее, архитектуры графических процессоров AMD и Nvidia довольно сильно отличаются друг от друга, как и качество кода драйверов и оптимизаций в играх для них, и далеко не всегда эти GPU показали себя одинаково хорошо. Надо сразу признать, что чаще всего в сравнении побеждали видеокарты Radeon, и это объясняется тем, что большинство игр выходит сейчас с их поддержкой, а поэтому в них внедряется использование новых графических API вроде Direct3D12 и Vulkan, а в этих условиях решения AMD чаще всего оказываются чуть быстрее, особенно при наличии специфических оптимизаций, схожих с консольными (архитектура-то одна — GCN).

Ну а для того, чтобы не судить обо всем исключительно голословно, давайте посмотрим на разницу в средних показателях по всем играм. Сначала для младшей пары протестированных сегодня видеокарт AMD и Nvidia:

| Radeon R9 380 против GeForce GTX 960 | Средние настройки | Ультра-настройки |

|---|---|---|

| Assassins Creed Odyssey | −14% | −38% |

| Borderlands 3 | +14% | +4% |

| Deus Ex: Mankind Divided | +18% | +11% |

| The Division 2 | +25% | +22% |

| F1 2019 | +17% | +22% |

| Far Cry 5 | +2% | 0% |

| Gears 5 | +2% | 0% |

| Hitman 2 | −5% | −3% |

| Metro Exodus | +20% | +5% |

| Red Dead Redemption 2 | +12% | +14% |

| Shadow of the Tomb Raider | +15% | +8% |

| Strange Brigade | +28% | +34% |

| World of Tanks RT | −3% | −5% |

| World War Z | +18% | +24% |

| Среднее | +11% | +7% |

Как можно видеть по таблице, среднее преимущество Radeon R9 380 над GeForce GTX 960 вроде бы не так уж велико: 11% при средних настройках качества и всего лишь 7% при ультра-настройках. Но средние значения на то и средние, чтобы показывать лишь общую картину — так называемую «среднюю температуру по больнице», а частности для нас куда важнее.

И если присмотреться к отдельным играм, то лишь в трех из них Radeon явно проиграл, еще в паре видеокарты были примерно равны, а в оставшихся девяти у видеокарты AMD было явное преимущество, которое порой превышало 20% и даже 30%! И хотя в первой игре нашего сравнения был и подобный же проигрыш у решения AMD, в целом мы отдаем явную победу видеокарте Radeon R9 380. Что же получилось со старшей парой?

| Radeon R9 390 против GeForce GTX 970 | Средние настройки | Ультра-настройки |

|---|---|---|

| Assassins Creed Odyssey | −9% | −3% |

| Borderlands 3 | +6% | +21% |

| Deus Ex: Mankind Divided | +17% | +53% |

| The Division 2 | +19% | +24% |

| F1 2019 | +18% | +16% |

| Far Cry 5 | −7% | −8% |

| Gears 5 | −1% | −2% |

| Hitman 2 | −2% | +4% |

| Metro Exodus | +15% | +3% |

| Red Dead Redemption 2 | +16% | +6% |

| Shadow of the Tomb Raider | +13% | +9% |

| Strange Brigade | +18% | +27% |

| World of Tanks RT | −10% | −12% |

| World War Z | +8% | +10% |

| Среднее | +7% | +11% |

Сразу же скажем, что некоторое преимущество от вдвое большего объема видеопамяти Radeon R9 390 получил даже в Full HD-разрешении — на это указывает тот факт, что его превосходство над GeForce GTX 970 при ультра-настройках оказалось выше, чем при среднем качестве. В остальном же все примерно как в предыдущей паре, и даже чуть хуже для видеокарты Nvidia, которая победила уже только в паре игр. В двух проектах получилась ничья, а в остальных — явное преимущество решения AMD.

Архитектуры графических процессоров AMD и Nvidia имеют важные отличия и требуют разной оптимизации, качество кода для D3D12 тоже разное, но в среднем с современными играми, использующими D3D12 и Vulkan, лучше справляются именно видеокарты Radeon. А вот при использовании D3D11, и особенно при ограничении производительности рендеринга универсальным процессором, ситуация уже иная: драйвер AMD явно не слишком хорошо оптимизирован для многопоточной работы, а у Nvidia такая оптимизация выполнена лучше, и поэтому в D3D11-играх лучше выглядят уже GeForce.

Получается, что графические процессоры компании AMD, вышедшие около пяти лет назад, в целом лучше подходят для современных нагрузок — ну, или нынешним играм не хватает качественной оптимизации под видеокарты Nvidia. Direct3D12 и Vulkan используются все чаще, особенно в мультиплатформенных играх, и игр с поддержкой новых API будет все больше и больше. Очень многое зависит также от разработчиков игр и поддержки со стороны производителей GPU, которые помогают оптимизировать код именно под свои решения.

Хотя все игры и движки по-разному оптимизированы для разных API и графических архитектур, факт остается фактом: в среднем обе видеокарты Radeon на чипах пятилетней давности оказались несколько лучше подготовлены к изменению характера нагрузок на GPU в последующие годы и выиграли в сражении. Ну, или с игровыми разработчиками команда AMD поработала лучше, что не умаляет однозначной победы видеокарт Radeon R9 3xx над GeForce GTX 9xx в современных условиях.